Among Us VRがアップデートされ、新マップの追加と期間限定の「INFECTION EVENT」がはじまりました。

アプリ購入者は無料アップデートでコンテンツが追加されます♪

では早速遊んでみましょう♪(動画)

ルールは簡単♪

クルーチームはゾンブリトー(ゾンビ)に見つからないようにタスクを合計10個処理すれば勝利。

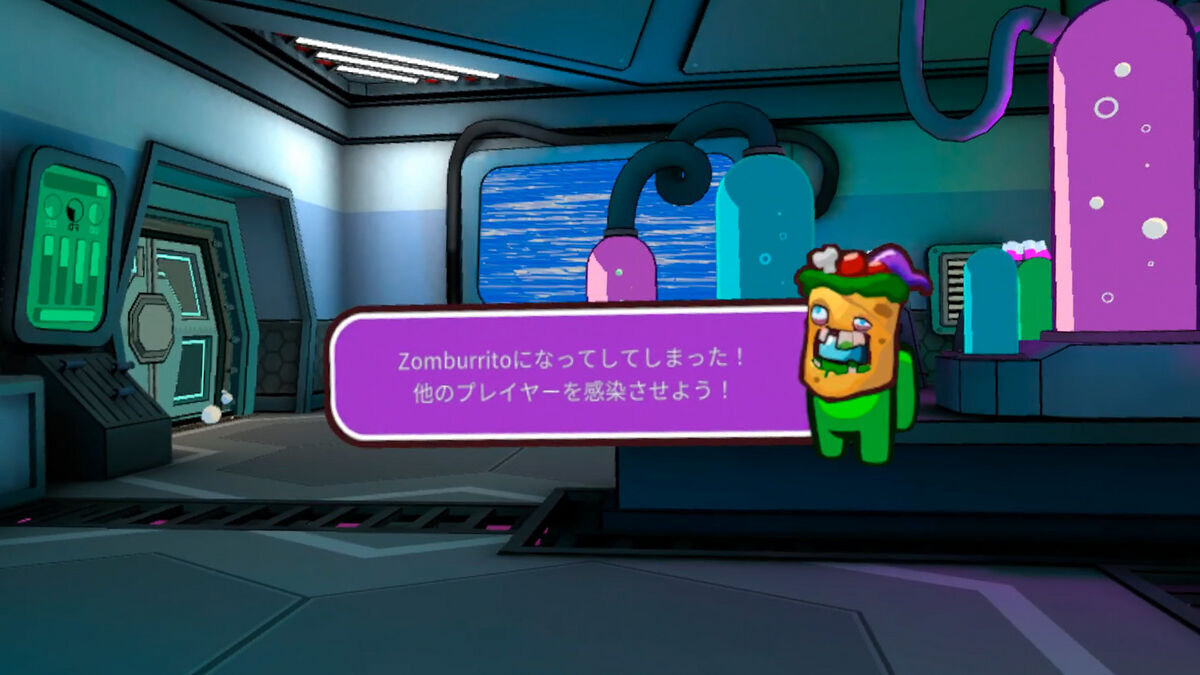

逆にゾンブリトー側はクルーを全員感染させれば勝利です。

ゲームがスタートするとクルーかゾンブリトーのいずれかになります。

| クルー | ゾンブリトー |

|---|---|

|

|

クルーになったらタスクをどんどん処理していきましょう!

通常ルールではインポスターにKILLされてもそのままタスク処理しますが、ゾンブリトーに感染させられたら自分もゾンブリトーとして感染を広める側になります。

|

|

新マップは行き止まりが多いので注意が必要です。

マップも狭いので展開が早く、サクサク遊べます♪

|

|

新マップで通常のプレイも

新マップでも通常ルールでプレイ可能です。

新しいタスクも追加されているので、これはこれで楽しいです♪

行き止まりが多いマップですが、全体的に狭いのでKILLするタイミングが難しいです…。

そもそもお求めやすい「Among Us VR」ですが、こまめにアップデートされてマップやイベントが追加されるので長く遊べますよ♪

www.meta.com

紹介リンク

紹介リンクからQuestシリーズを購入すると、アプリ購入などに利用できる3,000円分のポイントが貰えます♪

www.meta.com